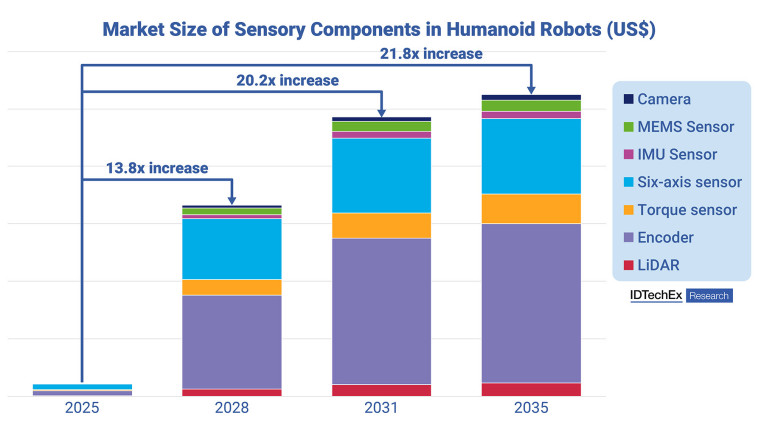

Ponieważ rok 2025 jest uważany za rok startu branży, IDTechEx przewiduje, że rynek komponentów sensorycznych robotów humanoidalnych, w tym LiDAR-ów, enkoderów, czujników momentu obrotowego, czujników 6-osiowych, IMU (Inertial Measurement Unit), czujników MEMS i kamer, osiągnie wartość około 10 mld dolarów w ciągu dziesięciu lat. Ten wzrost stwarza duże możliwości dla dostawców komponentów. Najnowszy raport badawczy IDTechEx - "Humanoid Robots 2025-2035: Technologies, Markets and Opportunities" - szczegółowo opisuje możliwości rynkowe, punkty zapalne, wyzwania produkcyjne, techniczne, handlowe i regulacyjne dotyczące tych komponentów.

Czujniki są niezbędne do funkcjonowania robotów humanoidalnych, służąc szerokiemu zakresowi celów. Umożliwiają nawigację i wykrywanie obiektów (np. LiDAR-y i kamery), kontrolę siły (np. czujniki momentu obrotowego i dotykowe) oraz zarządzanie pozycją i stabilnością (np. IMU). Niniejszy artykuł koncentruje się głównie na czujnikach dotykowych i czujnikach nawigacyjnych, w szczególności LiDAR-ach i kamerach.

Czujniki dotykowe dla robotów humanoidalnych

Czujniki dotykowe są krytycznymi komponentami robotów humanoidalnych, zwłaszcza w dłoniach, gdzie umożliwiają wykonywanie zadań takich, jak podnoszenie i umieszczanie obiektów. Te czujniki to złożone systemy, które integrują dane wejściowe, takie jak siła, poślizg, ciśnienie i moment obrotowy, aby generować dane, które kierują ruchami dłoni robota na podstawie kształtu, sztywności i miękkości obiektu. Jako jeden z najcenniejszych podsystemów w robotach humanoidalnych, czujniki dotykowe znacznie zwiększają kontrolę chwytu i manipulację obiektami. Umożliwiają one regulację siły chwytu w czasie rzeczywistym, by zapobiegać poślizgowi i umożliwić obsługę obiektów bez polegania na danych wizualnych.

Patrząc w przyszłość, czujniki dotykowe będą również odgrywać rolę w identyfikacji obiektów poprzez wykrywanie właściwości powierzchni i określanie charakterystyki materiału. Kilka technologii stanowi podstawę wykrywania dotykowego, w tym czujniki pojemnościowe, optyczne i magnetyczne.

Spośród nich optyczne czujniki dotykowe zazwyczaj oferują najwyższą precyzję, ale taka dokładność jest często niepotrzebna w obecnych zastosowaniach humanoidalnych maszyn. Czujniki pojemnościowe i magnetyczne zazwyczaj zapewniają wystarczającą rozdzielczość dla większości zadań. IDTechEx widzi elastyczne pojemnościowe czujniki dotykowe jako obiecujący kierunek ze względu na ich zdolność adaptacji, chociaż ich wrażliwość na wilgotność i temperaturę ogranicza ich zastosowanie w zmiennych środowiskach.

W przypadku bardziej złożonych pomiarów, takich jak wykrywanie siły 6D, nadal mogą być wymagane rozwiązania magnetyczne i optyczne. Czujniki dotykowe zazwyczaj kosztują od 0,4 USD/mm² do 1,2 USD/mm², w zależności od takich czynników, jak objętość, dostawca i rodzaj technologii. Więcej szczegółów na temat czujników dotykowych i ich zastosowań komercyjnych w humanoidalnych robotach znajduje się we wskazanym wyżej raporcie.

LiDAR i kamery dla robotów humanoidalnych

LiDAR-y i kamery to dwie podstawowe technologie sensoryczne, które umożliwiają robotom humanoidalnym nawigację, unikanie kolizji i wykrywanie obiektów. Od 2025 r. większość robotów humanoidalnych korzysta z kombinacji LiDAR i kamer, a Optimus Tesli stanowi znaczący wyjątek, polegając wyłącznie na kamerach. Integracja obu technologii jest w dużej mierze napędzana rosnącą złożonością środowisk, w których te roboty muszą się poruszać. Samo widzenie często nie wystarcza, aby poradzić sobie z nieprzewidywalnymi i dynamicznymi warunkami rzeczywistych zastosowań.

Według firmy Hesai Technology, wiodącego dostawcy LiDAR-ów, systemy oparte na widzeniu maszynowym mogą być odpowiednie w kontrolowanych środowiskach, takich jak linie produkcyjne, gdzie zadania i warunki oświetleniowe są stabilne. Jednak coraz częściej oczekuje się, że humanoidalne roboty będą działać w zróżnicowanych i niestrukturyzowanych środowiskach, wchodząc w interakcje z ludźmi, dostosowując się do zmieniających się poziomów oświetlenia i poruszając się po fizycznie złożonych przestrzeniach. W scenariuszach z jasnym światłem słonecznym, słabym oświetleniem lub szybko zmieniającymi się warunkami systemy oparte wyłącznie na kamerach mogą mieć problemy z niezawodnością i budzić obawy dotyczące bezpieczeństwa w interakcjach człowiek-robot.

LiDAR oferuje istotne uzupełniające możliwości. Umożliwia precyzyjne planowanie ścieżki, mapowanie 3D środowiska w czasie rzeczywistym i niezawodne wykrywanie przeszkód — nawet w słabo oświetlonych obszarach. Te funkcje są niezbędne dla humanoidów wykonujących zadania, takie jak umieszczanie obiektów w ciasnych przestrzeniach, unikanie nieoczekiwanych przeszkód w słabym oświetleniu lub nawigowanie po miejscach, w których oświetlenie jest ograniczone, na przykład po godzinach pracy fabryki. W środowiskach wysokiego ryzyka, jak górnictwo czy eksploracja tuneli, LiDAR dodatkowo zwiększa bezpieczeństwo i dokładność, umożliwiając robotom skanowanie i pewne nawigowanie po niebezpiecznym terenie.

Oczekuje się, że szybki wzrost wdrożeń robotów humanoidalnych doprowadzi do znacznego rozwoju komponentów sensorycznych, a rynek ten przekroczy 10 mld dolarów do 2035 roku. Wraz ze wzrostem wymagań dotyczących zręczności, czujniki dotykowe będą musiały być integrowane w sposób opłacalny, umożliwiając precyzyjną manipulację bez znacznego podnoszenia ogólnych kosztów systemu.

W przypadku LiDAR-ów i kamer ewoluujące wymagania dotyczące pełnej 360-stopniowej świadomości przestrzennej w robotach humanoidalnych wpłyną na przyszłe trendy projektowe. W przeciwieństwie do pojazdów autonomicznych, które zazwyczaj polegają na dalekosiężnych, skierowanych do przodu LiDAR-ach do wykrywania pasów ruchu i omijania przeszkód, roboty humanoidalne muszą działać w różnych środowiskach, które wymagają kompleksowego pokrycia przestrzennego. W rezultacie systemy LiDAR-owe nowej generacji prawdopodobnie będą priorytetowo traktować projekty o szerokim polu widzenia (FOV) z minimalnymi martwymi polami, szczególnie odpowiednie do zastosowań wewnętrznych, w których precyzyjna, wszechstronna świadomość ma kluczowe znaczenie, a prędkości operacyjne są niższe.

Źródło: IDTechEx