Te tradycyjne, zapewniające szybkość, precyzję i powtarzalność, wciąż pozostają niezastąpione w automatyzacji takich zadań, jak montaż, pakowanie czy paletyzacja. Roboty współpracujące, autonomiczne roboty mobilne i roboty humanoidalne to natomiast nowe rozwiązania, które całkowicie zmieniają sposób organizacji linii produkcyjnych i interakcji ludzi z maszynami. Wprowadzane są również nowe modele biznesowe, jak Robots as a Service (RaaS).

Roboty współpracujące (coboty) projektuje się do wykonywania zadań w kooperacji z ludźmi w warunkach przemysłowych. W przeciwieństwie do tradycyjnych robotów przemysłowych, które są oddzielone od operatorów fizycznymi barierami, takimi jak klatki czy ogrodzenia, coboty pracują z nimi ramię w ramię, w tym samym obszarze roboczym. International Federation of Robotics klasyfikuje cztery poziomy tej współpracy. W przypadku koegzystencji człowiek i robot pracują obok siebie, bez fizycznej bariery, ale nie dzielą przestrzeni roboczej. Przy współpracy sekwencyjnej pracują w tym samym obszarze roboczym, ale czynności wykonują kolejno, nigdy równocześnie na jednym elemencie. Kooperacja dopuszcza, by człowiek i robot jednocześnie wykonywali zadania na jednym obiekcie, pozostając w ruchu. Przy współpracy responsywnej robot reaguje w czasie rzeczywistym na ruchy człowieka, dostosowując swoje działania do jego pozycji i gestów.

Obecnie najczęściej spotykane formy współpracy to dzielenie przestrzeni roboczej, w której robot i człowiek koegzystują, pracując jeden obok drugiego i wykonując zadania niezależnie, albo praca sekwencyjna. Coboty podejmują przede wszystkim zadania, które są uciążliwe i nieergonomiczne, jak podnoszenie ciężkich elementów czy powtarzalne czynności montażowe, np. dokręcanie śrub. Stopniowo przybywa również stanowisk, na których w ramach kooperacji człowiek z robotem równocześnie pracują nad tym samym zadaniem, wykonując skoordynowane ruchy. Najbardziej zaawansowana technicznie współpraca responsywna nie jest jeszcze szeroko rozpowszechniona.

BEZPIECZEŃSTWO W PRACY COBOTÓW

Kluczową kwestią w przypadku cobotów jest bezpieczeństwo. Najważniejsze, aby uniknąć zetknięcia pracownika z robotem lub, gdy kontakt taki jest dozwolony i dochodzi do niego przypadkowo albo celowo, aby nie powodował on u człowieka obrażeń ani bólu. Założenia te osiąga się, realizując na zrobotyzowanym stanowisku zalecane przez standardy ISO 10218-1 i ISO 10218-2 sposoby kooperacji. W tym zakresie wyróżnia się cztery tryby: pracę z dostępną funkcją bezpiecznego kontrolowanego zatrzymania robota, prowadzenie ręczne, pracę z zapewnieniem monitorowanej prędkości i odległości człowieka od robota, jak również pracę przy ograniczonej sile i mocy robota.

Najczęściej coboty pracują w tym ostatnim trybie. Mogą wówczas bezpiecznie współpracować z ludźmi, ponieważ w przypadku kontaktu z czymkolwiek zatrzymują się. Dlatego są wyposażone w czujniki dotykowe, które wykryją zderzenie z innym obiektem. W tym celu wykorzystywane są sensory różnego typu. Przykładem – czujniki siły i momentu wbudowane w przeguby robota, w których monitoruje się także natężenie prądu silników napędów. Umieszczanie sensorów w tym elemencie stanowi jedno z popularniejszych rozwiązań. Czujniki siły i momentu są też montowane w podstawach cobotów.

Ponieważ w tym trybie pracy kontakt między człowiekiem a robotem jest dopuszczalny, powinien on być dla ludzi maksymalnie bezpieczny. Dlatego, aby ograniczyć potencjalne obrażenia, coboty muszą poruszać się bardzo wolno i mogą pracować wyłącznie przy ograniczonym udźwigu. Oprócz tego mają zwykle bardziej zaokrąglone kształty niż zwykłe roboty przemysłowe. Taka konstrukcja zapewnia rozłożenie siły uderzenia na większej powierzchni, co zmniejsza nacisk wywierany na obiekt, z którym robot się styka. Stosuje się również specjalnie wykonane podkładki (elastyczne, grube) amortyzujące uderzenia. Dzięki nim nie są przekraczane maksymalne dopuszczalne poziomy siły ani nacisku na ludzkie ciało.

ZALETY I OGRANICZENIA

Do zalet robotów współpracujących należy łatwość wdrożenia, co umożliwia szybkie zautomatyzowanie procesów w przedsiębiorstwach niedysponujących doświadczoną w tym zakresie kadrą inżynierską. Wynika to stąd, że ich programowanie jest proste – wiele modeli programuje się, przeprowadzając robota ręcznie przez kolejne etapy zadania. W połączeniu z możliwością łatwego przezbrajania przez wymianę modułów plug & play pozwala to na szybkie dostosowanie cobotów do krótkich serii produkcyjnych. Dzięki temu zaś, że nie wymagają dodatkowych zabezpieczeń, można je łatwo zintegrować w ramach już istniejących stanowisk, bez konieczności ponoszenia dodatkowych kosztów na ich dostosowanie, np. przez stworzenie odgrodzenia. Generalnie więc coboty stanowią ekonomiczny punkt wyjścia dla przedsiębiorstw, które dopiero zaczynają wdrażać rozwiązania zrobotyzowane.

Z powodu wymogu zapewnienia bezpiecznej współpracy z człowiekiem konstrukcyjnie nie zostały one jednak przystosowane do pracy z ciężkimi ładunkami ani z dużą prędkością. Z drugiej strony, dzięki temu, że są stosunkowo lekkie, łatwo je przenosić między stanowiskami i integrować z platformami mobilnymi. Należy także pamiętać, że same zabezpieczenia zastosowane w cobocie nie gwarantują bezpieczeństwa stanowiska. Robot współpracujący wyposażony np. w ostre narzędzie będzie zagrożeniem, nawet jeżeli jego prędkość i siła zostaną ograniczone. Dlatego wymagane jest przeprowadzenie analizy ryzyka dla całego stanowiska, obejmującej cobota, chwytaki, narzędzia, elementy obrabiane oraz pozostałe urządzenia w obszarze roboczym.

Uczenie przez naśladowanie

Pod pojęciem uczenia przez naśladowanie (imitation learning) rozumiemy podejście w uczeniu maszynowym, w którym agent (program komputerowy lub robot) zdobywa nowe umiejętności albo uczy się wykonywać określone zadania, obserwując i naśladując eksperta – człowieka, innego robota lub system sztucznej inteligencji, potrafiących poprawnie wykonać dane zadania. Celem jest nauczenie agenta optymalnej strategii działania poprzez mapowanie stanów na odpowiednie akcje. Innymi słowy, agent stara się zrozumieć, co należy zrobić w danej sytuacji i uczy się dobierać odpowiednie działania na podstawie przykładów. Uczenie przez naśladowanie rożni się od innych technik, np. uczenia przez wzmacnianie, w których agent zdobywa doświadczenie metodą prób i błędów, otrzymując nagrody za dobre decyzje i kary za złe. W tym przypadku agentowi prezentuje się przykłady – całe ścieżki działania albo pojedyncze pary: stan–właściwa reakcja. Dzięki temu może on opanować nawet bardzo złożone umiejętności, których trudno byłoby go nauczyć, opisując je w formie sztywnych reguł.

Uczenie przez naśladowanie sprawdza się w różnych branżach, umożliwiając robotom i systemom zautomatyzowanym wykonywanie złożonych zadań. Przykładem – stanowisko montażu w produkcji, na którym robot uczy się, obserwując pracownika. Jest to zazwyczaj dwuetapowy proces: najpierw maszyna uczy się przewidywać intencje stojące za działaniami człowieka, a następnie uczy się kontrolować własne ruchy, aby naśladować te działania.

Uczenie przez naśladowanie ma w dziedzinie robotyki wiele zalet. Przede wszystkim upraszcza programowanie robotów. Ich ruchy stają się bardziej naturalne, dzięki czemu maszyny lepiej odnajdują się w zadaniach wymagających ludzkiej zręczności. Robotom łatwiej się adaptować do nowych lub nieustrukturyzowanych środowisk. Są w stanie wykonywać złożone zadania oraz pogłębiać swoją interakcję z człowiekiem, co jest istotne zwłaszcza w przypadku robotów humanoidalnych, które uznaje się za cielesną formę sztucznej inteligencji. Złożoność modelowania dynamiki humanoidów rośnie wykładniczo z każdym kolejnym stopniem swobody. Dlatego uczenie przez naśladowanie uznaje się za jedną z najbardziej perspektywicznych technik, przynoszącą efekty i skalowalną w szerokim zakresie zadań i środowisk.

Z jej upowszechnieniem wiąże się jednak także szereg wyzwań. Przede wszystkim wysokiej jakości demonstracje prowadzone przez ekspertów trudno pozyskać, szczególnie w przypadku zadań specjalistycznych i krytycznych z punktu widzenia bezpieczeństwa. Dane ze świata rzeczywistego często zawierają szumy, błędy ludzkie oraz niespójności, które mogą negatywnie wpłynąć na efekt uczenia. Ponadto najlepiej sprawdzają się różnorodne przykłady, pozwalające na generalizowanie. Ograniczona zmienność danych treningowych skutkuje natomiast tym, że robot uczy się schematów, które później w praktyce nie sprawdzają się w nietypowych warunkach.

ROBOTY MOBILNE

Tego rodzaju roboty stanowią dynamicznie rozwijającą się dziedzinę robotyki, która obejmuje szeroki zakres urządzeń, o różnych sposobach poruszania się i zastosowaniach. Ich wspólną cechą jest zdolność do przemieszczania się w przestrzeni roboczej w sposób częściowo albo całkowicie autonomiczny. W zależności od środowiska wyróżnia się roboty mobilne lądowe, wodne i powietrzne. Najbardziej rozpowszechnione są konstrukcje lądowe, które wykorzystują różne mechanizmy – koła, gąsienice bądź nogi, dostosowane do specyfiki zadań oraz warunków terenowych.

W ostatnich latach szybko rozwijał się szczególnie segment autonomicznych robotów mobilnych AMR (Autonomous Mobile Robots), zdolnych do samodzielnego planowania ruchu, bez konieczności korzystania z odgórnie narzuconych fizycznych albo wirtualnych ścieżek. Dzięki zaawansowanym możliwościom percepcji i nawigacji potrafią one tworzyć mapy otoczenia, określać swoje położenie i wykrywać przeszkody, a w razie napotkania obiektów, nieprzewidzianych w planie trasy, są w stanie dynamicznie ją modyfikować, minimalizując ryzyko kolizji. Ta funkcjonalność odróżnia je od wózków samojezdnych AGV (Automated Guided Vehicles), poruszających się z góry określonymi i fizycznie wytyczonymi ścieżkami, bez orientacji w otoczeniu. Przez to zakres ich wykorzystania zawęża się do środowisk przemysłowych, gdzie kontakt z ludźmi jest nadzorowany i bardzo ograniczony. AMR są natomiast użytkowane także m.in. w magazynach, szpitalach, restauracjach i hotelach.

Autonomiczne roboty mobilne zwykle mają formę platformy transportowej, przewożącej ładunki, czasem dodatkowo wyposażonej w niezbędny osprzęt jak chwytaki. Materiały użyte do budowy mają wpływ na ich wagę, szybkość, zwrotność, wytrzymałość i bezpieczeństwo eksploatacji. Są to przeważnie sztywne i lekkie kompozyty, dzięki którym konstrukcja pozostaje trwała i zoptymalizowana pod kątem wagi. Przekłada się to na dłuższą żywotność, krótsze cykle pracy oraz mniejsze zużycie energii. Części, które mogą mieć kontakt z ludźmi albo elementami wyposażenia, zaokrągla się i pokrywa materiałami absorbującymi uderzenia.

NAWIGACJA I LOKALIZACJA

Tradycyjne roboty przemysłowe wykonują swoje zadania, powtarzając zaprogramowane sekwencje ruchów, co zapewnia dużą precyzję, ale nie pozwala na dostosowywanie się do zmian otoczenia ani stanu samego robota. Dlatego pracują one w kontrolowanych warunkach i są izolowane od ludzi. W odróżnieniu od nich roboty mobilne działają w środowiskach charakteryzujących się zmiennością (np. oświetlenia i sposobu organizacji przestrzeni), nieprzewidywalnością oraz w bezpośrednim sąsiedztwie ludzi i innych ruchomych obiektów, takich jak wózki widłowe. W związku z tym wymaga się od nich elastycznego reagowania. Robotom AMR taką możliwość zapewnia autonomia. Bywa ona różnie definiowana – zarówno jako zdolność do samodzielnego zaplanowania trasy, jak i jako pełne zrozumienie otoczenia oraz zdolność podejmowania decyzji w czasie rzeczywistym. Bez względu na jej poziom warunkiem osiągnięcia autonomii jest dostępność danych i implementacja technik ich przetwarzania oraz interpretacji.

Nawigacja AMR bazuje zwykle na algorytmach SLAM (Simultaneous Localization and Mapping), które umożliwiają jednoczesne tworzenie mapy otoczenia i określanie na niej aktualnego położenia robota na podstawie wyników pomiarów z wbudowanych sensorów. Ponieważ poszczególne techniki pozycjonowania w zmiennych warunkach środowiskowych charakteryzuje ograniczona precyzja, w praktyce systemy SLAM wykorzystują fuzję danych z różnych źródeł: lidarów, radarów, systemów GPS, enkoderów, czujników ultradźwiękowych. W ostatnich latach upowszechniają się też systemy VSLAM (Visual SLAM), które dodatkowo przetwarzają informacje z systemów wizyjnych 2D i 3D. Analiza obrazu z kamer zwiększa dokładność lokalizacji, ale jednocześnie wymaga stosowania zaawansowanych filtrów szumów i eliminacji informacji nadmiarowych. Trzeba także przetworzyć więcej danych. W związku z tym rozwój technik nawigacji SLAM/VSLAM jest silnie powiązany ze wzrostem mocy obliczeniowej procesorów i z postępami w dziedzinie optymalizacji algorytmów obróbki danych.

AUTONOMIA A BEZPIECZEŃSTWO

Podejmowanie decyzji w trybie autonomicznym umożliwiają robotom dwa typy algorytmów: deterministyczne oraz probabilistyczne.

Pierwsze z nich bazują na regułach reaktywnych typu „jeżeli spełniony został warunek x, to wykonaj czynność y” – np. „hamuj, jeśli czujniki wykryją obiekt w odległości mniejszej niż 1 m”. Przewidywalność zachowania robota w konkretnych warunkach gwarantuje stabilność i bezpieczeństwo.

Algorytmy drugiego rodzaju, oparte na analizie prawdopodobieństwa, pozwalają wybrać najwłaściwszy sposób postępowania w danych warunkach, więc priorytetem jest w tym przypadku zdolność adaptowania się do zmian zachodzących w otoczeniu. Na algorytmach probabilistycznych bazuje inteligencja semantyczna, umożliwiająca robotom zrozumienie kontekstu sytuacyjnego i znaczenia widzianych obiektów. Dzięki temu mechanizmowi potrafią one interpretować swoje otoczenie – nie tylko unikać przeszkód, ale również przewidywać zachowania pozostałych użytkowników danej przestrzeni roboczej, czyli ludzi i pojazdów, takich jak AGV lub wózki widłowe. Przykładowo, analizując trajektorię ruchu pracownika kierującego się w stronę drzwi, mogą przewidzieć trasę, którą będzie się on dalej poruszał i tak dostosować własny tor jazdy, aby ich drogi się nie przecięły.

AMR zazwyczaj wykorzystują obydwa typy algorytmów – deterministyczne i probabilistyczne. To gwarantuje równowagę pomiędzy stabilnością działania a możliwością adaptacji do dynamicznie zmieniającego się środowiska pracy. Im jednak wyższy poziom autonomii, tym większym wyzwaniem staje się zapewnienie bezpieczeństwa. Skoro robot potrafi samodzielnie podejmować decyzje, konieczne jest zagwarantowanie, że będzie on zawsze priorytetowo traktował zasady bezpieczeństwa, niezależnie od złożoności algorytmów sterujących jego działaniami. W tym celu wprowadza się hierarchię w procesie decyzyjnym, zgodnie z którą algorytmy deterministyczne mają bezwzględne pierwszeństwo nad probabilistycznymi. Nadrzędność tych pierwszych sprawia, że zachowania robota w sytuacjach krytycznych w obecności ludzi i przeszkód są przewidywalne i zgodne z zasadami bezpieczeństwa. Co więcej, funkcje bezpieczeństwa muszą być uruchamiane lokalnie, niezależnie od dostępności sieci komunikacyjnych, tak aby nawet w razie utraty łączności lub awarii systemu centralnego robot nie stanowił zagrożenia.

Autonomia obejmuje także zdolność do działania w ramach większego procesu produkcyjnego albo logistycznego. Oznacza to, że roboty AMR wymieniają się informacjami z innymi maszynami i systemami, by dostosowywać swoje działania do aktualnej sytuacji operacyjnej. Jeśli np. robot, który otrzymał zadanie dostarczenia ładunku na dane stanowisko, uzyskuje informację, że na linii produkcyjnej w tym miejscu notuje się opóźnienie, może samodzielnie zmienić punkt docelowy, aby przekierować ładunek na inne, dostępne stanowisko. Wymaga to zaimplementowania algorytmów decyzyjnych, które potrafią uwzględniać czynniki zewnętrzne i dynamicznie zmieniać priorytety zadań.

ROBOTY HUMANOIDALNE

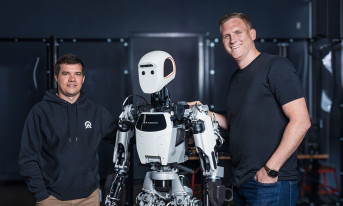

W dziedzinie robotów humanoidalnych w ostatnim czasie nastąpił znaczący przełom. W mediach zaczęto prezentować coraz więcej maszyn, które potrafią chodzić, komunikować się z otoczeniem i operować rękoma. Wraz z pojawieniem się modeli tego typu wizja do tej pory znana z literatury i filmów science fiction zaczęła się stopniowo urzeczywistniać, a kolejne pilotażowe wdrożenia zwiastują nadchodzącą rewolucję w robotyce.

Z technicznego punktu widzenia roboty humanoidalne stanowią platformy ogólnego przeznaczenia, czyli uniwersalne maszyny, które dzięki zdolności do adaptowania się do specyfiki danej czynności mogą wykonywać różne zadania, bez konieczności ich przezbrajania. Co więcej, ze względu na budowę oraz mechanikę ruchu, wzorowanych na cechach ludzkich, humanoidy odnajdują się w przestrzeniach, które zostały zaprojektowane pod kątem potrzeb i możliwości człowieka. Dzięki temu nie jest wymagane dostosowywanie stanowisk pod kątem ich ograniczeń, jak ma to miejsce w przypadku tradycyjnych robotów.Prognozuje się, że roboty humanoidalne mogą rozwiązać globalne problemy na rynku pracy wynikające z niedoborów siły roboczej i starzenia się społeczeństw – przede wszystkim w przemyśle, logistyce, opiece zdrowotnej, usługach i wojsku. Choć ich masowa komercjalizacja stanowi na razie odległą przyszłość, potencjalne korzyści, jakie może przynieść, z pewnością napędzać będą ich szybki rozwój, któremu dodatkowo sprzyjać będzie postęp technologiczny.

Czym są VLAM?

Przed wprowadzeniem modeli Vision Language Action (VLAM) robotyka i sztuczna inteligencja rozwijały się w oddzielnych obszarach: modele wizyjne potrafiły rozpoznawać obrazy, te językowe rozumiały i generowały tekst, a systemy sterowania kierowały ruchami. W każdej z tych dziedzin następował bardzo szybki postęp, ale opracowane rozwiązania dobrze sprawdzały się, jeżeli były wykorzystywane niezależnie. Brakowało możliwości ich współpracy, pozwalającej robotom na radzenie sobie w nieprzewidywalnych warunkach.

Tradycyjne modele widzenia komputerowego, oparte głównie na splotowych sieciach neuronowych, były dostosowywane do wąsko określonych zadań, takich jak wykrywanie i klasyfikacja obiektów. Wymagały bardzo dużych, oznaczonych zestawów danych treningowych i uciążliwego ponownego szkolenia w przypadku zaistnienia nawet niewielkich zmian w środowisku lub celach. Dzięki tym modelom robot wprawdzie „widział” – np. był w stanie odróżnić na przenośniku jabłka uszkodzone od zdrowych, ale brakowało mu zdolności rozumienia poleceń w języku naturalnym, jak również zdolności przekładania spostrzeżeń wizualnych na działania. Modele językowe, szczególnie duże modele językowe (Large Language Models, LLM), zrewolucjonizowały rozumienie i generowanie tekstu, ale nadal ograniczały się do przetwarzania języka naturalnego, bez zdolności postrzegania i rozumienia świata fizycznego. Systemy sterowania, oparte na zestawach reguł lub metodach uczenia maszynowego, takich jak uczenie przez wzmacnianie, umożliwiały wykonywanie zadań w rodzaju manipulowania obiektami, ale wymagały żmudnego trenowania i miały problem z uogólnianiem poza wąsko zdefiniowanymi scenariuszami, co utrudniało adaptację do nowych zadań i środowisk.

W praktyce większość systemów sterowania opartych na sztucznej inteligencji korzystała co najwyżej z dwóch „umiejętności” – widzenia i rozumienia języka naturalnego, widzenia i działania lub rozumienia języka naturalnego i działania, nie potrafiła jednak połączyć ich w jeden spójny model. W efekcie robot rozpoznawał obiekty, rozumiał instrukcje tekstowe albo wykonywał zaprogramowaną czynność, ale nie potrafił płynnie łączyć tych trzech umiejętności – percepcji, rozumienia i działania – w elastyczne, adaptacyjne zachowanie, stanowiące podstawę autonomii.

Pilna potrzeba wypełnienia tej luki zaowocowała przyspieszeniem prac nad opracowaniem modeli VLAM. Pierwsze takie rozwiązania udostępniono na przełomie lat 2021 i 2022. Przetwarzają one dane wizyjne, interpretują polecenia w języku naturalnym i generują komendy sterujące ruchem, umożliwiając robotom postrzeganie otoczenia, rozumienie instrukcji i wykonywanie odpowiednich działań.

CZYM JEST ROBOT HUMANOID?

International Federation of Robotics zaproponowała ujednoliconą definicję robota humanoidalnego, która ma stanowić globalnie akceptowany punkt odniesienia dla dalszych prac nad nimi i podstawę standaryzacji. Według niej jest to maszyna o estetycznym wyglądzie, która przypomina człowieka, zazwyczaj z dwoma ramionami, dwiema nogami, tułowiem i głową, zdolna do wykonywania zadań w otoczeniu zaprojektowanym dla ludzi, bez konieczności jego przystosowania. Jej możliwości są dodatkowo zwiększane dzięki zmysłom podobnym do ludzkich, takich jak widzenie, słyszenie i dotyk, umożliwiających wchodzenie w interakcję z ludźmi i otoczeniem.

Obowiązuje także krótsza, uproszczona definicja, podana w normie ISO 8373:2021, w której zestandaryzowano terminologię z zakresu robotyki przemysłowej. Zgodnie z nią robot humanoidalny ma tułów, głowę oraz kończyny i wygląda oraz porusza się jak człowiek. Spotyka się różne realizacje mieszczące się w obu definicjach – zwykle roboty humanoidalne mają tułów, głowę, dwie ręce i dwie nogi, choć niektóre mają tylko głowę i górną część tułowia zamocowaną na platformie na kołach umożliwiających im poruszanie się.

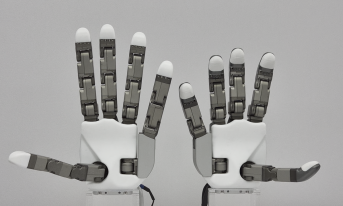

Postęp w wielu dziedzinach techniki ułatwia ich konstruowanie. Przykład stanowi dostępność lekkich, a zarazem trwałych materiałów konstrukcyjnych oraz miniaturyzacja podzespołów elektronicznych, dzięki którym roboty humanoidalne są zwinniejsze niż dotąd i uzyskują bardziej „ludzki” wygląd. Czujniki dotyku i siły chwytania zwiększają ich precyzję i zręczność. Miniaturyzacja sensorów oraz postępy w dziedzinie silników elektrycznych zwiększają możliwości sterowania napędami, co poprawia dynamikę ruchu stawów robotów humanoidalnych. Dzięki temu potrafią one wykonywać złożone czynności, jak bieganie, skakanie i wspinanie się, również po nierównym terenie, zachowując przy tym równowagę. Kamery oraz sensory laserowe, które dostarczają danych systemom lokalizacji SLAM, zapewniają orientację w nieznanym otoczeniu. Sztuczna inteligencje zwiększa ich autonomię, a zaawansowane algorytmy uczenia maszynowego, oparte na technikach naśladowania (patrz ramka: „Uczenie przez naśladowanie”), jak modele VLAM (Vision Language Action Models; patrz ramka: „Czym są VLAM?”) umożliwiają nabywanie umiejętności przez obserwację ludzi. Brak danych szkoleniowych nie stanowi problemu dzięki symulacjom z wykorzystaniem cyfrowych bliźniaków. Z kolei dzięki postępom w technikach przetwarzania języka naturalnego oraz rozpoznawania emocji na podstawie mimiki i gestów roboty humanoidalne coraz lepiej rozumieją i stosowniej reagują na emocje wyrażane za ich pośrednictwem przez ludzi. Dostępność procesorów zoptymalizowanych pod kątem wymogów implementacji algorytmów AI – co umożliwia wdrożenie przetwarzania brzegowego – pozwala im na podejmowanie decyzji w czasie rzeczywistym. Rozwój technologii akumulatorów czyni je natomiast bardziej praktycznymi w długotrwałym użytkowaniu.

Oprócz licznych zalet roboty tego rodzaju mają również, niestety, ograniczenia w porównaniu z tradycyjnymi modelami przemysłowymi. Przede wszystkim do pewnych zadań się nie nadają – paradoksalnie właśnie ze względu na swoje podobieństwo do ludzi. Chodzi głównie o te czynności, które muszą być wykonywane z dużą szybkością, a zarazem z precyzją i powtarzalnością. W takich przypadkach roboty humanoidalne ustępują przemysłowym pod względem szybkości (ze względu na prostsze sterowanie tymi drugimi) oraz niezawodności, dzięki wzmocnionej konstrukcji modeli przemysłowych, wymaganej np. na stanowiskach spawania, paletyzacji, montażu. Roboty tradycyjne mają także zwykle większy udźwig. Na ich korzyść przemawia też to, że są wyspecjalizowane pod kątem konkretnych zadań. Roboty humanoidalne natomiast, zgodnie z ich formalną definicją, stanowią platformy ogólnego przeznaczenia. Ich mobilność w połączeniu ze zdolnością interakcji sprawia, że lepiej sprawdzają się w funkcji pomocniczej i w usługach. Niestety, w bezpośrednim kontakcie ich ludzki wygląd i zachowanie paradoksalnie mogą wzbudzać u ludzi dyskomfort, niechęć, a nawet strach – zjawisko to określane jest terminem dolina niesamowitości (uncanny valley).

ROBOTS AS A SERVICE

Innowacje w dziedzinie robotyki nie obejmują wyłącznie sprzętu i oprogramowania, ale także nowe rozwiązania biznesowe, dzięki którym roboty stają się coraz łatwiej dostępne. Takim jest Robots as a Service (RaaS). W modelu tym z maszyn można korzystać bez ich zakupu. W zamian wynajmuje się je razem z dostępem do oprogramowania, wsparcia technicznego, serwisu oraz usług dodatkowych, zależnie od szczegółów konkretnej oferty.

RaaS występuje w różnych wariantach. W subskrypcyjnym klient płaci stałą miesięczną albo roczną opłatę. Alternatywą jest wariant pay per use, w którym opłata zależy od liczby godzin pracy robota lub wykonanych zadań. Dostępne są też rozliczenia hybrydowe, łączące abonament z opłatą za dodatkowe funkcje albo czas pracy. Zwykle model ten jest skalowalny – wynajmujący może dowolnie zwiększać lub zmniejszać liczbę robotów w zależności od bieżących potrzeb, co sprawdza się szczególnie w przypadku wdrożeń sezonowych i przy dużej zmienności wolumenu produkcji oraz częstych zmianach asortymentu.

Model RaaS ma wiele zalet. Przede wszystkim obniża koszty początkowe, ponieważ firma nie musi jednorazowo dużo inwestować w sprzęt ani w jego wdrożenie. Umożliwia elastyczne oraz szybkie skalowanie działalności. Dostawca takiej usługi odpowiada za aktualizacje, konserwację i naprawy, co zmniejsza koszty operacyjne, jakie ponosi klient i w przypadku wystąpienia awarii przerzuca odpowiedzialność na dostawcę. Ponadto wynajmujący uzyskuje dostęp do najnowszych technologii bez konieczności wymiany robotów co kilka lat we własnym zakresie.

Występują tu jednak także ograniczenia, które należy wziąć pod uwagę, rozważając, czy warto z RaaS skorzystać. Przede wszystkim klient pozostaje w kwestii dostępności robotów całkowicie zależny od dostawcy. Ponadto długoterminowe koszty subskrypcji mogą przewyższyć koszt zakupu własnych maszyn. W związku z tym model jest atrakcyjny głównie dla małych oraz średnich przedsiębiorstw, które chcą szybko rozpocząć proces robotyzacji produkcji, nie dysponując od ręki dużymi środkami.

Monika Jaworowska