Szkło jest materiałem o szerokim zastosowaniu – wykonuje się z niego szyby, opakowania, szklane dekoracje. Produkuje się je z piasku kwarcowego, do którego ze względu na jego bardzo wysoką temperaturę topnienia dodaje się topniki (węglan sodu, węglan wapnia, węglan potasu). Zmniejsza to energochłonność procesu topienia. Mieszankę piasku i topników uzupełnia się też o stabilizatory oraz środki klarujące, które usuwają z masy szklanej pęcherzyki powietrza (siarczan sodu, arszenik, saletrę). Kolejny składnik zestawu szklarskiego to stłuczka szklana, którą pozyskuje się z wyrobów ze szkła, które poddano recyklingowi. Jej dodatek zmniejsza koszty produkcji, dzięki ograniczeniu zużycia surowców oraz energii, ponieważ stopienie stłuczki wymaga mniejszej ilości ciepła.

Substancje nadające szkłu specjalne właściwości to z kolei m.in.: tlenek glinu, który poprawia jego odporność chemiczną, tlenki ołowiu, które zwiększają współczynnik załamania światła oraz tlenek boru, zmniejszający współczynnik rozszerzalności. Specjalne dodatki mogą także zmieniać barwę szkła: miedź na niebieską, chrom – zieloną albo żółtą, mangan – fioletową, kobalt – niebieską lub zieloną, selen – różową, fluor – mleczną.

Proces wytapiania szkła

Mieszankę piasku z dodatkami stapia się w piecu. W produkcji ciągłej odbywa się to w wannie szklarskiej. Na jednym z jej końców znajduje się kieszeń zasypowa, którą automatycznie podawany jest zestaw szklarski. W miarę jego przerabiania ubytki uzupełnia się nowymi porcjami surowców. Po ogrzaniu płomieniami z palników te ostatnie ulegają stopieniu. Powstała w ten sposób masa szklana stopniowo wypełnia całą wannę. Przepływające w przeciwległy koniec wanny szkło jest klarowane.

Pod wpływem wysokiej temperatury i ruchów konwekcyjnych masa zostaje wymieszana. Usuwane są z niej również pęcherzyki gazów, będące efektem reakcji chemicznych, które zachodzą podczas topienia się składników zestawu szklarskiego. Następnie szkło zostaje schłodzone. Temperatura w wannie jest regulowana stosownie do potrzeb, od największej w sekcji klarowania, do coraz niższej, tuż przed uformowaniem gotowych wyrobów.

Piece wannowe opala się gazem ziemnym, olejem opałowym lub gazem generatorowym. Powietrze w mieszance z paliwem coraz częściej zastępuje się czystym tlenem, który poprawia efektywność energetyczną pieca i zmniejsza ilość szkodliwych związków emitowanych do atmosfery. Pierwszą polepsza także system odzysku ciepła ze spalin.

Wyjście wanny szklarskiej stanowi wyprowadzenie masy szkła do kolejnego etapu jej obróbki – formowania. Sposób jego realizacji zależy od rodzaju produktu końcowego – inaczej przebiega w przypadku szkła płaskiego (patrz: ramka), a inaczej produkuje się butelki.

Jak się produkuje i tnie szyby?Szkło płaskie wytwarza się m.in. metodą float. Wykorzystuje się w niej dwie połączone wanny. W pierwszej topi się surowce, z kolei drugą, która jest płytsza, wypełnia się roztopioną cyną. Stanowi ona podłoże, po którym rozlewa się masa szklana, która wypływa z pierwszej wanny. W ten sposób powstaje tafla. Jej grubość reguluje się przez zmianę szybkości, z jaką masa szklana wpływa do drugiego zbiornika. Szkło utrzymuje się na powierzchni cyny, ponieważ gęstość tego materiału jest kilka razy mniejsza niż gęstość metalu. W związku z tym, że cyna się utlenia, w otoczeniu drugiej wanny trzeba wytworzyć, a potem utrzymać atmosferę o składzie chemicznym, który zapobiegnie postępowi tego procesu. W tym celu używa się mieszanki azotu z wodorem. Gotowe tafle szklane rozcina się na mniejsze, korzystając z różnych narządzi i maszyn.

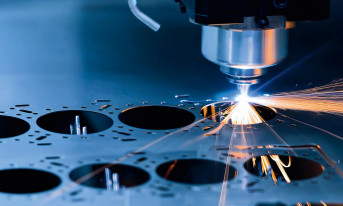

W metodzie mechanicznej szkło zarysowuje się twardym, ostrym narzędziem, na przykład ostrzem diamentowym, a następnie przykłada siłę, powodującą rozejście się tego pęknięcia wzdłuż grubości szkła. Metoda ta ma kilka wad, zwłaszcza w przypadku cięcia cienkich płyt szklanych: wokół rysy powstają mikropęknięcia, na krawędziach występują naprężenia, brzegi nie zawsze są prostopadłe do powierzchni szkła, a żeby zapobiec jego pękaniu w przyszłości, krawędzie należy zeszlifować. Oprócz tego szkło trzeba oczyścić z okruchów, które powstają przy rozcinaniu. Alternatywą jest cięcie laserem. Wyróżnić można generalnie dwie techniki cięcia cienkiego szkła laserem. Pierwszą stosuje się dla płytek o grubości 0,3–0,7 mm. Polega ona na ogrzaniu szkła na linii cięcia laserem i szybkim schłodzeniu go cieczą albo powietrzem z dyszy. Na skutek szoku termicznego, który te czynności wywołują, szkło pęka, zwykle do głębokości 100 μm. Potem po tafli przesuwa się wałek. Pod jego naciskiem pęknięcie rozchodzi się wzdłuż grubości szkła. Bardzo cienkie płytki, o grubości poniżej 0,2 mm, są z kolei wiele razy wolno ogrzewane na linii cięcia laserem aż do momentu przecięcia. Cięcie laserem nie powoduje mikropęknięć, odprysków na krawędziach ani naprężeń w strukturze. Jest również szybsze niż cięcie mechaniczne, ponieważ można pominąć etapy szlifowania krawędzi oraz czyszczenia szkła. Pomimo dużych kosztów zakupu wycinarki laserowej oszczędza się na maszynach do dodatkowej obróbki. Laserem łatwiej jest też wycinać różne kształty, m.in. zaokrąglenia. |

Maszyny specjalistyczne w produkcji butelek

Na linii produkcji butelek masa szklana z wanny szklarskiej wypływa przez specjalne kanały (zasilacze). Stąd, po wcześniejszym rozdzieleniu na porcje (krople), jest podawana do automatów do formowania opakowań. Są to maszyny specjalistyczne, których działanie jest wzorowane na pracy hutników wydmuchujących szklane przedmioty. W zależności od typu butelek, a tym samym grubości ich ścian i rozmiaru otworów, stosuje się różne techniki produkcji. Na przykład butelki o grubych ściankach i wąskich otworach wytwarza się metodą blow and blow.

Jest to proces dwuetapowy. W pierwszej kolejności w porcji szkła wyrabia się otwór i wydmuchuje z niego bańkę. Potem przekłada się ją do formy w kształcie wyrobu gotowego i znów wydmuchuje, tym razem właściwy kształt.

Butelki z cienkimi ściankami, wykonywane metodą press and blow, także produkuje się w dwóch krokach. Najpierw bańkę wyrabia się przez sprasowanie środka masy szklanej za pomocą tłoka. Wtedy wykonuje się także wylot butelki. W drugim kroku bańkę przenosi się do formy końcowej i wydmuchuje gotowy wyrób. Gdy butelka uzyska ostateczny kształt, jest schładzana do temperatury poniżej temperatury deformacji. Następnym krokiem jest odprężanie, polegające na powolnym studzeniu szkła w celu relaksacji naprężeń termicznych. Dalsze etapy obróbki zależą od specyfiki produktu – butelki znakuje się albo zdobi.

Pomiary i sterowanie w produkcji szkła

Kluczową zmienną procesową w produkcji szkła jest temperatura. Mierzy się ją w kilku miejscach pieca szklarskiego, m.in.: w sklepieniu wanny, na dnie wanny, w zasilaczach. Temperatura sklepienia pieca musi być kontrolowana z kilku powodów. Utrzymanie tej właściwej ma na przykład wpływ na żywotność pieca, jego przegrzanie przyspiesza bowiem erozję ogniotrwałej wykładziny. Za niska temperatura z kolei wpływa na efektywność topienia surowców oraz zużycia paliwa. Analogiczne przesłanki skłaniają do pomiaru tej wielkości w dnie wanny. W kontroli temperatury w sklepieniach oraz na dnach części pieców szklarskich wykorzystuje się zwykle termopary. Czujniki te są także używane do kontroli temperatury masy szklanej w zasilaczach. Ponadto w tym celu korzysta się z pirometrów.

W piecach szklarskich mierzy się też takie wielkości jak: ciśnienie, poziom i przepływ. Ciśnienie i przepływ należy kontrolować na przykład w przypadku paliwa (gazu) i powietrza. Ciśnienie mierzy się także w przestrzeni ogniowej pieca i w kanałach spalinowych. Dzięki temu można przykładowo sprawdzić szczelność pieca. Ważną wielkością jest oprócz tego poziom masy szklanej.

Na podstawie wyników pomiarów kontroluje się elementy wykonawcze. Na przykład zaworami, które dozują paliwo i powietrze do palników, steruje się w oparciu o odczyty temperatury, z kolei automatami, które ładują surowce do wanny – na podstawie zmian w poziomie stopionej masy szklanej. W związku z tym, że w procesie wytopu szkła występuje wiele zaburzeń, na przykład waha się temperatura powietrza do spalania, zmienia się skład surowców oraz właściwości paliwa (kaloryczność), w sterowaniu piecami szklarskimi stosuje się m.in. algorytmy adaptacyjne. W kontroli pracy tych obiektów znajduje również zastosowanie logika rozmyta.

Jak się produkuje płytki ceramiczne?

Potocznie ceramika to wypalona, wcześniej odpowiednio uformowana, glina. Szerzej definiuje się ją jako materiał nieorganiczny i niemetaliczny, który w procesie produkcji poddaje się działaniu wysokiej temperatury i który w postaci gotowego wyrobu też charakteryzuje się dużą odpornością na temperaturę. Oprócz gliny do produkcji ceramiki obecnie wykorzystuje się także tlenki, azotki, węgliki, krzemki, borki, fosforki, tellurki oraz selenki. Gama wyrobów ceramicznych jest również bardzo szeroka – obejmuje m.in. naczynia, dekoracje, izolatory elektryczne, armaturę łazienkową i płytki do wykładania ścian i podłóg.

Pierwszy krok w produkcji tych ostatnich to zmielenie surowców na proszek i wymieszanie ich we właściwych proporcjach. Następnie do tej mieszanki dodaje się wodę. W kolejnym etapie zawiesinę rozpyla się w strumieniu gorącego powietrza, co powoduje, że woda odparowuje, a w zbiorniku, nad którym się to odbywa, gromadzi się sproszkowany materiał ceramiczny. Można już z niego wtedy uformować korpus płytki ceramicznej. W tym celu wykorzystuje się połączone działanie ciepła i siły, umieszczając nagrzany proszek w formie poddawanej naciskowi w prasie. Zagęszcza go to, nadając płytkom kształt, rozmiar i, w przypadku płytek ceramicznych dekorowanych, ich fakturę. Następnie podsusza się je oraz glazuruje, czyli pokrywa powłoką ze szkliwa. Płytki są wówczas gotowe do dekorowania metodą sitodruku lub obecnie częściej, druku cyfrowego. Oprócz poprawy estetyki płytek, glazurowanie i zadrukowywanie zapewniają im wodoodporność, trwałość oraz właściwości higieniczne. Ostatnim etapem produkcji jest wypalenie płytek w piecu. Proces ten utwardza bryłę płytek, glazurę i farby dekoracyjne, utrwalając ich kształt oraz wzór zdobienia. Po stopniowym schłodzeniu są one gotowe do sprzedaży.

Kontrola jakości w produkcji farbJeżeli farba nie spełnia wymogów jakościowych, powłoka wykonana przy jej użyciu też nie będzie się cechowała dobrą jakością – spodziewać się można m.in. słabego pokrycia, zacieków, nie takiego wykończenia, jak zakładano (brak połysku, chropowatość) i nietrwałości. Zależnie od rozmiarów pomalowanej powierzchni może to powodować duże straty czasu, pracy i materiałów w związku ze zużyciem farby oraz koniecznością ponownego przygotowania podłoża, jeżeli zdecydowano się na poprawki. Aby temu zapobiec, trzeba dopilnować, żeby farba cechowała się odpowiednią lepkością – jest to kluczowy wyznacznik jakości dla tej kategorii materiałów budowlanych. Dlatego w czasie produkcji farb powinno się ją monitorować. Ze względu na specyfikę tego parametru nie jest to jednak łatwe. Dlaczego należy kontrolować lepkość farby?

W przemyśle farbiarskim lepkość jest parametrem warunkującym zastosowanie farby, na przykład do malowania ścian w budynkach lub do wykańczania powierzchni metalowych, drewnianych itp. Poza tym ma wpływ na sposób nakładania powłoki malarskiej – za pomocą pędzla, wałka, natrysku. Dla każdego z tych zastosowań i metod aplikacji lepkość musi mieć optymalną wartość, jest ona bowiem zasadniczo miarą grubości powłoki. To natomiast wpływa na właściwości użytkowe farb i w efekcie nanoszonych powłok, w tym ich strukturę, zgodność kolorów, trwałość, odporność na środki chemiczne, występowanie pęcherzy powietrza. Generalnie także farba nie powinna zmieniać swoich właściwości podczas przechowywania i być łatwa do nałożenia. Jaka jest optymalna lepkość?Lepkość farby zmienia się na skutek różnych czynników podczas produkcji i aplikacji powłoki. Na przykład w fabryce, gdy jest pompowana między kolejnymi stanowiskami produkcyjnymi, poddaje się ją ścinaniu od umiarkowanego do silnego, jej przechowywanie oraz transport to z kolei zwykle etapy charakteryzujące się małym ścinaniem. Także proces jej nanoszenia cechuje się różnym, od umiarkowanego (przy malowaniu pędzlem) do silnego ścinania (powlekanie wałkiem, natrysk). W związku z tym oczekuje się, że generalnie farby będą spełniały następujące warunki: przy małym ścinaniu (<10[1/s]) powinny mieć dużą lepkość przypominając pod tym względem ciała stałe, co pozwala zapobiec rozdzielaniu się faz i sedymentacji, przy średnim (10–1000 [1/s]), na które są narażone typowo podczas produkcji, muszą mieć średnią lepkość, tak by były łatwe do pompowania i mieszania. Podczas nakładania (>1000[1/s]) farba musi być z kolei na tyle rzadka, aby można ją było łatwo aplikować pędzlem, wałkiem itp. Zalety ciągłych pomiarów lepkościPomiar lepkości w hali produkcyjnej lub w laboratorium kontroli jakości przy użyciu tradycyjnych przyrządów, takich jak wiskozymetry, którymi bada się pobrane próbki, jest pracochłonny, czasochłonny i podatny na niedokładności oraz błędy ludzkie. Ponadto pojedyncze wyniki nie zapewniają pełnej informacji o właściwościach farb – pomiar punktowy byłby wystarczający tylko wówczas, gdyby farby miały taką samą lepkość dla wszystkich prędkości ścinania występujących podczas produkcji i aplikacji, co nie jest prawdą. W kontroli jakości produkcji znacznie użyteczniejsze są w związku z tym krzywe lepkości, które obejmują określony zakres szybkości ścinania. Do zbierania takich danych wykorzystywane są procesowe analizatory lepkości, które w sposób ciągły monitorują tę wielkość podczas produkcji farb. Przynosi to licznie korzyści. Przede wszystkim pozwala szybko zidentyfikować i skorygować błędy podczas procesu produkcyjnego, jeśli zaś problem z lepkością zostanie wcześnie wykryty, można zmniejszyć liczbę wybrakowanych partii farb. Zmniejsza to koszty produkcji i poprawia jej wydajność. |

Dekorowanie płytek ceramicznych – ograniczenia sitodruku

Wypalanie jest najdroższym etapem produkcji płytek ceramicznych – żeby zmniejszyć jego koszt, piec często pracuje nieprzerwanie, co zapobiega marnowaniu energii na każdorazowe rozgrzewanie go do wymaganej temperatury powyżej +1000°C. W związku z tym wymagana jest również ciągła dostawa płytek gotowych do wypalenia, dlatego zwykle w takiej fabryce musi pracować więcej niż jedna linia ich produkcji. Ponadto piec można wykorzystać najefektywniej, jeśli jest załadowany do pełna, tymczasem klienci coraz częściej zamawiają krótkie, spersonalizowane serie. Do niedawna wyzwaniem był również proces dekorowania płytek ceramicznych, gdyż powszechnie stosowana metoda sitodruku ma wiele wad, przekładających się na koszt i wydajność produkcji.

Kluczową jest długi czas przygotowania szablonu i rolek za każdym razem, gdy zmienia się treść nadruku. Czaso- i pracochłonne jest również zapewnienie spójności kolorów, bowiem pod wpływem ekstremalnie wysokich temperatur podczas wypalania między pigmentami w tuszu i glazurą zachodzą reakcje, które powodują zmianę barw nadruku w stosunku do tych nanoszonych. Dlatego, aby sprawdzić ostateczne kolory, trzeba wykonać próbne wypalenie zadrukowanej płytki, w przypadku sitodruku – po każdej wymianie rolki. To zwiększa koszty i straty materiału. Długie przezbrajanie oraz trudne zarządzanie kolorami utrudnia planowanie produkcji, zwłaszcza krótkich serii. Przygotowanie szablonu (wzoru na rolce) też nie jest łatwe i bez odpowiednich umiejętności trudno uzyskać realistyczne i wysokiej jakości nadruki, co zwiększa koszt płytek zdobionych przez wyspecjalizowanych producentów. Ponadto metodą sitodruku można dekorować wyłącznie płaskie płytki – ponieważ jest to metoda kontaktowa, nie nadaje się do wykonywania nadruków na płytkach z teksturą. Nie można też zadrukowywać krawędzi, dlatego płytki zdobione tą techniką mają białe, niezadrukowane obramowanie. Konsekwencją tego, że jeszcze niewypalone, kruche płytki wchodzą w kontakt z rolką, jest oprócz tego możliwość ich uszkodzenia, z czym wiążą się straty materiałów (płytki, szkliwa, tuszu). Ograniczenia te sprzyjają produkcji długich serii i utrzymywaniu zapasów wyrobów gotowych – wówczas w przypadku powtórnego takiego samego zamówienia można je zrealizować łatwiej i taniej, niż próbując odtworzyć oryginalne kolory.

Druk cyfrowy w produkcji płytek ceramicznych

Alternatywą jest druk cyfrowy rozwiązujący większość problemów, których źródłem jest sitodruk. W przypadku dekorowania płytek ceramicznych jego największą zaletą jest to, że jest to proces bezkontaktowy – odległość pomiędzy zadrukowywanym podłożem a głowicą drukującą wynosi zazwyczaj kilka milimetrów. Dzięki temu płytki nie ulegają uszkodzeniu pod wpływem nacisku. Można również dekorować te teksturowane, wypełniając tuszem zagłębienia wzorów będące poza zasięgiem rolek maszyn do sitodruku. Technika ta pozwala ponadto na pokrycie nadrukiem całej płytki, aż po jej krawędzie. Druk cyfrowy pozwala na wykonywanie bardziej skomplikowanych i większych wzorów – dostępne są drukarki, które mają wystarczającą ilość pamięci, aby odtworzyć te o powierzchni nawet kilkudziesięciu m² bez powtórzeń, płytkami z indywidualnym wzorem można zatem wyłożyć całe pomieszczenie. Technikę tę wyróżnia też duża rozdzielczość wydruków, dzięki której na nadrukach rozróżnialne są najdrobniejsze szczegóły, a zdobienia płytek są bardziej realistyczne – trudno je na przykład odróżnić od prawdziwego marmuru lub kamienia. Konfiguracja drukarek, zmiana wzorów oraz zarządzanie kolorami są realizowane programowo, co upraszcza powielanie dekoracji i barw. Łatwo i tanio można zatem zadrukowywać nawet krótkie serie płytek.

Warto dodać, że chociaż obecnie metoda cyfrowa jest dominującą w zdobieniu płytek ceramicznych od wprowadzenia na rynek pierwszej takiej drukarki pod koniec lat 90. zeszłego wieku do ich upowszechnienia się upłynęła prawie dekada. Wynikało to stąd, że ich producenci potrzebowali czasu, by dopracować konstrukcje głowic drukujących, dostosowując je do wyzwań, jakie stawia im drukowanie na ceramice. Po pierwsze, proces produkcyjny płytek generuje dużo pyłu. Po drugie, po opuszczeniu prasy te niewypalone są kruche, gorące oraz parujące. Ponadto tusz do drukowania na ceramice, żeby można było uzyskać żywe kolory, musi zawierać duże, nierozpuszczalne cząsteczki pigmentu utrzymywane w zawiesinie. Przez to jest bardzo lepki oraz podatny na wytrącanie się osadów. Z tych powodów w pierwszych drukarkach często dochodziło do zatykania się dysz, przez co jakość druku była słaba, a dysze wymagały częstego czyszczenia. To powodowało przestoje i nie pozwalało na korzystanie z druku cyfrowego w produkcji na masową skalę. Ponadto początkowo, z powodu małej rozdzielczości, wydruki były ziarniste, zaś części zamienne do drukarek i tusze – drogie.

Kontrola jakości płytek ceramicznych

Z czasem problemy te nie tylko udało się rozwiązać, ale poza udoskonaleniem konstrukcji głowic, wprowadzono także szereg innych ulepszeń. Przykładowo nowoczesne systemy druku cyfrowego, wykorzystując kamery, wykrywają ułożenie płytki na taśmie z dużą dokładnością i same się regulują, co gwarantuje prawidłową orientację i położenie drukowanego obrazu. Dzięki temu nie trzeba stosować rozwiązania, w którym nanoszony obraz celowo poszerza się tak, żeby zrekompensować ewentualne przesunięcie płytki względem jej pożądanego ustawienia i w ten sposób uniknąć pozostawienia na niej niezadrukowanych fragmentów. Główne wady takiego podejścia to jednak: strata atramentu oraz zabrudzenie nim taśmy. Poza ograniczeniem kosztów tuszu i konserwacji dzięki funkcji automatycznego centrowania obrazu nie są też potrzebne prowadnice do układania płytek w linii ani ręczne centrowanie tych wielkogabarytowych, które są ciężkie.

Postęp w zakresie wykonywania nadruków nie oznacza jednak, że są one bez skazy, więc kontrola jakości jest obowiązkowym etapem w produkcji płytek ceramicznych. W jej ramach sprawdza się je nie tylko pod kątem nieprawidłowości w zdobieniach, ale i innych braków. Dostępne są stanowiska kontroli wizyjnej, które rozpoznają różnego typu wady w strukturze i dekoracji płytek, wyposażone w zestaw kamer i oświetlenie zoptymalizowane pod kątem inspekcji wyrobów ceramicznych o dużej odblaskowości. W nowoczesnych rozwiązaniach tego typu coraz powszechniej wdraża się techniki sztucznej inteligencji, na przykład w funkcji samouczenia się, która autonomicznie ustala poziomy akceptacji dla poszczególnych cech płytek lub funkcji detekcji koloru, która uwzględnia zacienienie. Oprócz kamer stanowiska kontroli jakości płytek ceramicznych wykorzystują lasery, dzięki którym można wykryć krzywiznę i ubytki na ich bokach, sprawdzić wymiary, wykryć brak kątów prostych i zweryfikować płaskość – w tym celu na ich powierzchni wyświetla się matrycę punktów albo serię linii i porównuje się je z ich obrazem dla płytki wzorcowej.

Jak się produkuje cement?

Cement to spoiwo budowlane z grupy hydraulicznych – po zmieszaniu z wodą wiąże i twardnieje w procesie hydratacji (uwodnienia), a po stwardnieniu pozostaje wytrzymały i trwały także pod wodą. Jest jednym ze składników do produkcji betonu. Chociaż technologia jego produkcji jest znana od stuleci, sukcesywnie się ją udoskonala. Generalnie jest to proces ciągły, choć wyróżnić można także etapy w trybie wsadowym.

Surowce do produkcji cementu dobierane są na podstawie ich składu chemicznego. Jego głównym składnikiem jest źródło tlenku wapnia – najczęściej jest to wapień, ale mogą to być również kreda, margiel, dolomit, a nawet muszle ostryg. Kolejne dwa składniki to krzemionka i tlenek glinu, które otrzymuje się z gliny albo łupków. Można też użyć kwarcu i boksytu lub innych minerałów. Ważny składnik to poza tym tlenek żelaza, uzyskiwany z rudy żelaza, pirytu albo żużla wielkopiecowego. Surowce, po przetransportowaniu do zakładu, są zwykle składowane w silosach.

W kolejnym kroku mieli się je i miesza, metodą suchą lub mokrą. Rozdrabnianie jest kontynuowane aż do uzyskania cząstek o wielkości wymaganej w kolejnym etapie produkcji. Mielenie odbywa się na ogół w młynach kulowych, przeważnie po użyciu kruszarki wstępnej. W procesie mieszania na sucho surowce łączy się w odpowiednich proporcjach i magazynuje w silosach. Są to przeważnie zbiorniki homogenizujące, wykorzystujące powietrze do mieszania swojej zawartości. W procesie mokrym do surowców dodaje się wody, co ułatwia ich mieszanie. Wadą tej metody jest konieczność odparowania wody, która zwiększa energochłonność procesu. Zawiesina uzyskiwana metodą mokrą jest przechowywana w zbiornikach z ciągłym mieszaniem.

Kolejnym, kluczowym, etapem w produkcji cementu jest wypalanie mieszanki surowców, w postaci mączki albo zawiesiny, na klinkier w piecu obrotowym. W przykładowym wykonaniu jest to długa, cylindryczna, stalowa rura, nachylona w dół od strony wlotu i wyłożona od wewnątrz materiałem ogniotrwałym, która obraca się wokół własnej osi. Z jednej strony podawany jest surowiec, a druga jest ogrzewana przez gazy spalinowe przemieszczające się w przeciwprądowym wymienniku ciepła w górę pieca w stronę wlotu surowca. Przepływ ciepła przyspiesza wbudowany w piec wentylator. W procesie wypalania klinkieru wyróżnia się cztery fazy. W pierwszej z nich w przypadku obróbki zawiesiny odparowywana jest woda. Następnie dalsze ogrzewanie surowca powoduje rozpoczęcie rozkładu węglanu wapnia – jest to strefa kalcynacji. Produkt uboczny tej reakcji – dwutlenek węgla – jest usuwany z pieca, a materiał wzbogacony tlenkiem wapnia przesuwa się do strefy o najwyższej temperaturze (około +1400°C). W niej zachodzą reakcje łączenia tlenku wapnia, krzemionki, tlenku glinu i tlenku żelaza, których wynikiem jest klinkier. Materiał ten na wyjściu z pieca jest schładzany podczas transportu przez chłodnicę rusztową wyposażoną w zestaw wentylatorów wymuszających obieg zimnego powietrza. W ten sposób obniża się jego temperaturę do takiej, która umożliwia jego dalszą obróbkę, wymaga on bowiem rozdrobnienia, przeważnie w młynie kulowym. Dodaje się do niego także niewielką ilość gipsu w celu zahamowania szybkiego wiązania.

Case study: Produkcja cementuPewien zakład produkujący cement został wyposażony w nową maszynę pakującą. Wkrótce po instalacji zgłoszono problemy w jej działaniu – tolerancja wag oraz szybkość workowania były inne, niż oczekiwano. Ponadto maszyna została zaprojektowana tak, by całkowicie opróżniała się wraz z końcem cyklu produkcyjnego. Niestety okazało się, że gdy jej zasobnik wypełniony był jeszcze cementem w ilości wystarczającej do napełnienia 2–3 worków, materiał ten przestawał się z niego wysypywać. Stanowiło to duży problem, ponieważ w zakładzie produkowane były głównie krótkie serie produktu. W związku z tym częsta zmiana gatunku cementu wymagała każdorazowego otwierania i czyszczenia zasobnika między partiami. Oznaczało to spore straty produktu oraz czasu, przekładając się na spadek wydajności pakowania. By rozwiązać problem, zwrócono się o pomoc do dostawcy maszyny. Wstępny przegląd nie ujawnił żadnych nieprawidłowości w pracy elementów mechanicznych i sterujących, zauważono jednak, że manometr przy komorze pakowarki nie mierzy ciśnienia. Przeprowadzono więc diagnostykę układu ciśnieniowego składającego się oprócz komory również z układu wytwarzania poduszki powietrznej fluidyzującej cement oraz zaworu sterującego dmuchawą. Najpierw szukano ewentualnych przeszkód, które blokowałyby przepływ powietrza do układu wytwarzania poduszki powietrznej, ale ich nie znaleziono. Potem sprawdzono dmuchawy – jak się okazało, zamiast tych oryginalnych, zaprojektowanych do dostarczania powietrza w objętości i pod ciśnieniem wymaganymi do prawidłowego działania pakowarki, wykorzystano te z poprzednio tu pracującej maszyny. Były one zużyte i mniejsze, a oprócz tego zauważono, że ich odpowietrzniki zmodyfikowano w taki sposób, że połowa powietrza, które miało zasilić pakowarkę, była usuwana na zewnątrz. Oczywistą decyzją w takim przypadku była wymiana starych dmuchaw na oryginalne. Niestety nie było to możliwe, ponieważ ze względu na trwający cykl produkcyjny linii workowania cementu nie można było całkiem zatrzymać. Dlatego zdecydowano się na rozwiązanie doraźne – wymianę zaworów bezpieczeństwa na te oryginalne, po wcześniejszym wprowadzeniu w nich drobnych zmian hydraulicznych. Niestety nie rozwiązało to problemu – wydajność dmuchaw wciąż była zbyt mała. Wówczas zmodyfikowano działanie pakowarki – zamiast rozdziału strumienia powietrza z dmuchaw na dwa: regulujący ciśnienie w głowicy napełniającej oraz zasilający proces fluidyzacji, w całości przekierowano go do układu wytwarzania poduszki powietrznej. Chociaż rozwiązanie to nie było pozbawione wad, w stopniu wystarczającym poprawiło dokładność wag worków i szybkość ich napełniania. Po jakimś czasie jednak zauważono, że waga paczek z cementem znowu zaczyna się wahać. Okazało się, że przyczyną jest zbyt niskie ciśnienie w głowicy napełniającej w związku z odłączeniem dmuchawy. Przez część cyklu produkcyjnego było to rekompensowane przez ciśnienie produktu w zasobniku, ale gdy jego poziom spadał poniżej określonego, malało również ciśnienie w dozowniku, co wpływało na konsystencję pakowanego materiału, a w efekcie wagę worków. Jako rozwiązanie tego problemu wdrożono system kontroli poziomu cementu w zasobniku – jeżeli jest za niski, maszyna workująca jest automatycznie zatrzymywana do czasu jego uzupełnienia. |

Pomiary i sterowanie w wypalaniu klinkieru

Pracę pieców do wypalania klinkieru nadzorują sterowniki w oparciu o dane z licznych czujników. Ich celem jest regulowanie krytycznych zmiennych procesowych pieca oraz współpracującej z nim chłodnicy rusztowej, przy jednoczesnym ograniczaniu zużycia paliwa w piecu i energii elektrycznej przez zespoły wentylatorów zimnego powietrza w chłodnicy. Kluczową wielkością mierzoną oraz regulowaną jest oczywiście temperatura – w piecu monitorują ją zwykle czujniki kontaktowe, a na etapie chłodzenia pirometry. Mierzone jest również stężenie tlenku węgla i poziomy tlenu i tlenków azotu. Kontrolowana jest ponadto wysokość złoża klinkieru w chłodnicy rusztowej. Trzeba też monitorować zawartość wolnego wapna. W tym celu przeprowadza się analizę laboratoryjną próbek klinkieru, które są pobierane na wyjściu pieca typowo nawet kilka razy dziennie.

W zakresie sterowania natomiast lokalne regulatory, zwykle PID, zarządzają pętlami sterowania: natężeniem przepływu mączki (lub zawiesiny), dopływem powietrza oraz paliwa w sekcji spalania, ciśnieniem w piecu, prędkością wentylatorów w piecu i w sekcji chłodzenia. Oprócz ograniczenia zużycia energii ich celem jest stabilizowanie i optymalizacja procesu spalania w oparciu o dane o jakości surowca i klinkieru, w tym uzyskanie tego ostatniego o założonej jakości charakteryzowanej stężeniem wolnego wapna oraz przestrzeganie ograniczeń systemu, mechanicznych (parametry pracy silnika, pieca, jego pojemność), termodynamicznych (temperatura i stężenie tlenu w piecu) oraz środowiskowych, odnoszących się do stężenia tlenku węgla, tlenków azotu i innych gazów w spalinach.

Jakie są rodzaje styropianu?

Tytułowy materiał jest odmianą polistyrenu, tworzywa sztucznego powszechnie wykorzystywanego w budownictwie i m.in. branży opakowaniowej. Polistyren to twardy, sztywny materiał, który wytwarzany jest w procesie polimeryzacji styrenu. Ten ostatni otrzymuje się z kolei w dwóch etapach, najpierw przez połączenie etylenu z benzenem w obecności katalizatora w celu uzyskania etylobenzenu, a potem jego odwodornienie przez przepuszczenie z parą wodną nad katalizatorem. Popularność polistyrenu wynika z różnorodności form, w jakich jest dostępny.

Przykłady to polistyren ogólnego przeznaczenia (General Purpose Polystyrene, GPPS) i polistyren wysokoudarowy (High Impact Polystyrene, HIPS). GPPS jest przezroczysty, ale kruchy, natomiast HIPS jest nieprzezroczysty, ale znacznie wytrzymalszy niż GPPS, dzięki dodaniu kopolimerów butadienu. Najpopularniejszą formą polistyrenu jest jednak pianka, która potocznie jest nazywana styropianem. Wyróżnia się dwa jego rodzaje: polistyren ekspandowany (Expanded Polystyrene, EPS) i polistyren ekstrudowany (Extruded Polystyrene, XPS).

Główną różnicą między nimi jest sposób produkcji. EPS jest wytwarzany przez stapianie ekspandujących polistyrenowych kulek w formie, która może mieć dowolny kształt. XPS z kolei jest produkowany przez ciągłe wytłaczanie w miarę rozszerzania się kulek. W ten sposób powstają płaskie płyty, które można następnie formować termicznie i przycinać do różnych zastosowań. Oba rodzaje pianek składają się głównie z powietrza, dzięki czemu są bardzo lekkie i mają właściwości izolacyjne. Charakteryzuje je także wytrzymałość na ściskanie.

Proces produkcji EPS pozwala na wykonanie go w dowolnym kształcie, dzięki czemu nadaje się do bardziej różnorodnych zastosowań. Ponieważ XPS jest z kolei produkowany w płaskich płytach, jest często używany jako izolacja w budownictwie, chociaż płyty XPS również można formować termicznie i przycinać na dowolne kształty. Główna różnica strukturalna między EPS i XPS polega na tym, że pomiędzy stopionymi kulkami EPS nadal istnieją przestrzenie, co umożliwia łatwiejsze przechodzenie powietrza i wilgoci. Inaczej jest w przypadku XPS, który zapewnia lepszą izolację termiczną oraz wodoodporność, z drugiej jednak strony po przedostaniu się wilgoci EPS wysycha szybciej.

Maszyny specjalistyczne w produkcji EPS

Produkcja styropianu ekspandowanego obejmuje kilka etapów. Pierwszym jest wstępne rozprężenie przy użyciu środka porotwórczego (spieniającego, poroforu). W tym celu polistyrenowy granulat ogrzewa się za pomocą pary (jest to najpopularniejsza metoda) albo gorącego powietrza. Powoduje to przemianę środka porotwórczego, który zmienia się w gaz pod wpływem wysokiej temperatury, powodując spienienie granulatu. Proces ten zachodzi przy jego ciągłym mieszaniu, co ma zapobiec stopieniu się ze sobą polistyrenowych kulek.

Rozprężanie wstępne jest przeprowadzane w specjalistycznych maszynach – ekspanderach. Są to zazwyczaj urządzenia pracujące w trybie wsadowym, gdyż w przypadku pracy ciągłej trudno jest efektywnie kontrolować parametry procesu mające kluczowe znaczenie dla właściwości styropianu. Rezultat końcowy jest wypadkową skuteczności regulacji głównie: ciśnienia, temperatury i czasu. Jeśli na przykład rozprężanie wstępne trwa za długo, kulki granulatu mogą się zapadać. Ekspander w związku z tym ma zwykle postać uszczelnionej komory parowej, do której w kolejnych cyklach doprowadzany jest wsad granulatu polistyrenowego. Wyposaża się ją w reduktor ciśnienia i czujniki tej wielkości. W przypadku ogrzewania za pomocą gorącego powietrza w komorze ekspandera montuje się dodatkowe sensory temperatury i zawór proporcjonalny, którym doprowadzane jest sprężone powietrze. Żeby z kolei kontrolować gęstość materiału, mierzone są również: waga zawartości zbiornika oraz poziom jego wypełnienia – aby odczyty tej wielkości nie były zafałszowane przez drgania, które towarzyszą pracy maszyny, korzysta się zwykle z wibracyjnych sygnalizatorów poziomu.

Gdy ekspandowane kulki EPS osiągną określony rozmiar, są odsysane z ekspandera wstępnego do zbiorników, w których są magazynowane, wstępnie spienione kulki wymagają bowiem zazwyczaj „starzenia” przez co najmniej 24 do nawet 72 godzin. Pozwala to na dyfuzję powietrza do kulek, ochłodzenie ich i stwardnienie. Po starzeniu kulki wprowadza się do formy o pożądanym kształcie. Pod wpływem pary wodnej i wysokiego ciśnienia kulki ponownie się rozszerzają i stapiają ze sobą. Następnie formę chłodzi się, na przykład przez opryskiwanie jej zimną wodą z zewnątrz.

Monika Jaworowska